robots文件是網(wǎng)站優(yōu)化運(yùn)營(yíng)中,站長(zhǎng)最容易忽視的一個(gè)細(xì)節(jié),例如robots文件錯(cuò)誤覆蓋或誤封禁,給網(wǎng)站帶去不必要的流量損失,那么robots文件錯(cuò)誤覆蓋或誤封禁了要如何解決呢?下面黑帽百科給大家分享解決方法。

案例說明:

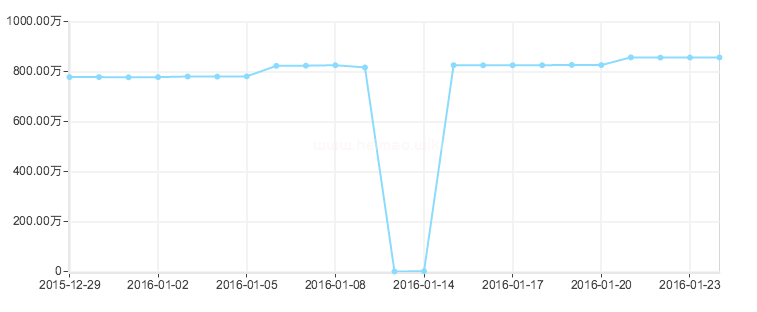

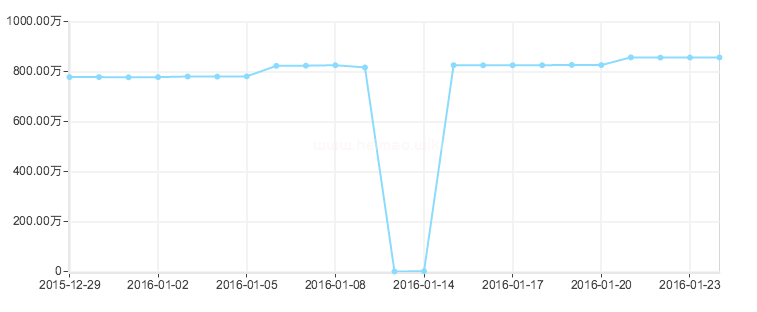

許多站長(zhǎng)在開發(fā)網(wǎng)站程序新功能時(shí),選擇在線開發(fā),為了避免搜索引擎抓取網(wǎng)站程序新功能的開發(fā)版本,于是乎使用robots文件封禁了全站,等待網(wǎng)站程序新功能開發(fā)完成后,直接使用新程序版本覆蓋了原程序,包括robots文件,幾天后發(fā)現(xiàn)網(wǎng)站流量大幅度下降,網(wǎng)站索引量降至0,網(wǎng)站關(guān)鍵詞也大量掉線。

robots文件該怎么設(shè)置,可點(diǎn)擊《Robots.txt文件要如何正確設(shè)置》這篇文章。

處理方式:

1、修改網(wǎng)站Robots文件,然后到百度站長(zhǎng)平臺(tái)更新robots;

2、使用百度站長(zhǎng)平臺(tái)抓取診斷工具檢測(cè),可能剛剛開始檢測(cè)會(huì)顯示抓取失敗,沒關(guān)系,多試幾次就可以抓取成功了;

3、使用百度站長(zhǎng)平臺(tái)抓取頻次工具,修改網(wǎng)站抓取頻率;

4、在百度站長(zhǎng)平臺(tái)的反饋中心向百度搜索進(jìn)行反饋,說明這次操作是誤操作才導(dǎo)致的發(fā)生了這種情況;

5、在百度站長(zhǎng)平臺(tái)的資源提交頁(yè)面,設(shè)置網(wǎng)站數(shù)據(jù)實(shí)時(shí)推送;

6、更新網(wǎng)站sitemap地圖文件,并且提交給百度,設(shè)置24小時(shí)更新一次;

以上步驟都處理完成以后,接下來就只有等待了,正常情況幾天后網(wǎng)站數(shù)據(jù)就會(huì)慢慢恢復(fù)了,1個(gè)星期左右網(wǎng)站數(shù)據(jù)就可以恢復(fù)正常。

案例總結(jié):

下面給大家總結(jié)下,避免大家以后也出現(xiàn)此類的問題。

1、不要為了圖方便省事,選擇在線開發(fā)網(wǎng)站;

2、網(wǎng)站開發(fā)或升級(jí)要有流程記錄,例如在開發(fā)網(wǎng)站做了哪些處理,哪些不需要給搜索引擎抓取,哪些需要給搜索引擎抓取,這些一定要非常清楚;

3、要經(jīng)常查看百度后臺(tái)數(shù)據(jù),關(guān)注網(wǎng)站流量及數(shù)據(jù)變化,及時(shí)發(fā)現(xiàn)問題,及時(shí)進(jìn)行處理。